Google מציגה: Private AI Compute – בינה מלאכותית בענן בלי לוותר על פרטיות ב-Pixel 10

Google מציגה את Private AI Compute עבור Pixel 10: ארכיטקטורת ענן מאובטחת שמאפשרת הרצת מודלי AI כבדים, תוך הצפנת זיכרון, הסתרת IP, attestation וחסימת גישת אדמינים – כך שגם Google כמעט אינה יכולה לראות את נתוני המשתמשים.

בעוד יצרניות סמארטפונים מתחרות על עוד פיצ'ר AI נוצץ, Google מנסה לפתור את השאלה המאתגרת באמת: איך מפעילים מודלים ענקיים בענן בלי להפוך את הנתונים האישיים של המשתמשים לזהב מודיעיני? התשובה החדשה שלה נקראת Private AI Compute, והיא כבר פועלת מאחורי הקלעים של סדרת Pixel 10.

למה בכלל צריך AI בענן?

חלק מהמודלים שמניעים את יכולות ה-AI החדשות של ה-Pixel 10 פשוט כבדים מדי להפעלה על המכשיר עצמו. כדי לספק תמלול חכם, סיכומים בשפות נוספות ופיצ'רים מתקדמים כמו Magic Cue, Google מריצה מודלים עוצמתיים בתשתית הענן שלה. אבל כאן נולדת הדילמה: שליחת מידע רגיש מהטלפון אל שרתי החברה.

Private AI Compute נועדה לסגור את הפער הזה – לאפשר שימוש במודלים עתירי ביצועים בענן, תוך מינימום אמון נדרש ב-Google עצמה.

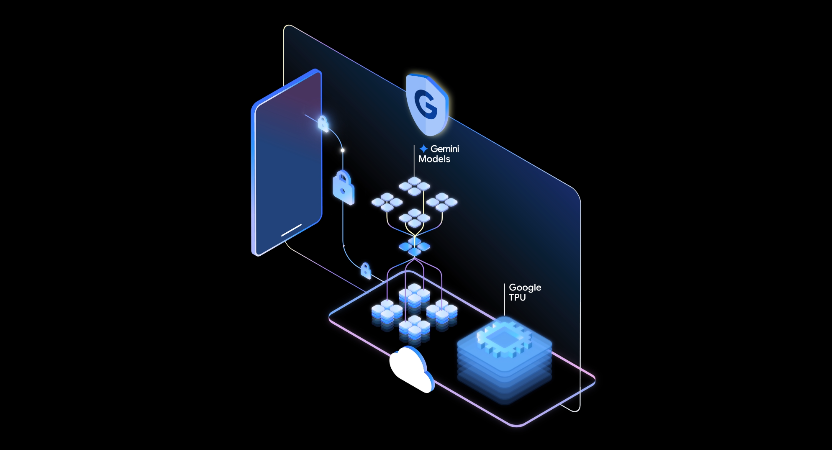

כך נראית הארכיטקטורה מאחורי הקלעים

Google בנתה שכבות הגנה מרובות סביב המערכת:

-

TPU ייעודיים (Ironwood): מודלי ה-AI הרציניים רצים על שבבי TPU מותאמים אישית של Google, בדור Ironwood, שמקובצים לאשכולות עם ביצועים של עשרות Exaflops. הם יושבים על שרתים "מחוזקים" שבהם Google נועלת גישת shell כדי למנוע שינוי קוד או השתלת malware, גם על ידי אדמינים.

-

שרתי ביניים עם AMD SEV-SNP: מכשירי Pixel לא מתחברים ישירות ל-TPU. במקום זאת, התעבורה עוברת דרך שרתים עם מעבדי AMD ותמיכה ב-SEV-SNP, טכנולוגיית הצפנה שמחלקת את הזיכרון למרחבים מוצפנים, כך שכל מכונה וירטואלית רואה רק את שלה. אפילו ה-hypervisor ומערכת ההפעלה אינם יכולים לקרוא את תוכן הנתונים.

-

Attestation לפני כל חיבור: לפני שמכשיר מתחיל לדבר עם השרת מתבצעת בדיקת attestation – אימות קריפטוגרפי שמוודא שהמערכת שמקבלת את הנתונים מריצה קוד מוכר ולא סביבת תקיפה מחופשת.

-

IP Blinding Relays: Google מנתקת בין זהות המשתמש לבין תוכן העיבוד. תעבורת Private AI Compute עוברת דרך מנגנוני IP blinding שמסתירים את כתובת ה-IP של המשתמש. המשמעות: גם אם מישהו היה מצליח לצפות בנתונים זורמים, קשה עד בלתי אפשרי לשייך אותם לאדם ספציפי.

-

הגנות מול Side-Channel Attacks: SEV-SNP כולל מנגנונים להפחתת סיכונים של התקפות צד, שמנסות לחלץ מפתחות או מידע רגיש דרך מדידת צריכת חשמל, זמנים וכדומה.

השורה התחתונה: המערכת מעוצבת כך שגם מפעילת התשתית – Google עצמה – מוגבלת ביכולת לראות נתוני משתמשים.

איפה זה כבר עובד היום?

בשלב זה Private AI Compute משמש מספר יכולות מרכזיות ב-Pixel 10:

- Recorder עם סיכומים מתקדמים: מאפשר הפקת סיכומי תמלול בשפות נוספות, מעבר למה שניתן היה להריץ רק על המכשיר.

- Magic Cue: סט פיצ'רים שמסייע למצוא מידע רלוונטי בשירותי Google, תוך הסתמכות על מודלים חזקים בענן – בלי לחשוף את זהות המשתמש בצורה ישירה.

מה זה אומר עבור משתמשים וטכנולוגים בישראל?

עבור קהל שמבין ענן, חומרה ואיומי סייבר, המהלך הזה של Google מסמן כיוון מעניין: מודלים גדולים בענן לא חייבים להגיע על חשבון פרטיות. Private AI Compute הוא גם הצהרה טכנולוגית וגם שיווקית – ניסיון להראות שאפשר ליהנות מ-GenAI חכם במובייל, עם ארכיטקטורה שממזערת את הצורך ב"תסמכו עלינו".

או כפי שכותב ג'יי יאגניק, סמנכ"ל חדשנות ו-AI ב-Google: "זו רק ההתחלה". אם המודל הזה יוכיח את עצמו, הוא עשוי להפוך לסטנדרט דה-פקטו לבינה מלאכותית אישית בענן.